20. 학습의 단계_n8n -1일차 (시작) -

1단계. 학습의 단계

1. AWS Bedrock

첫번째 강의) Building Multi-Agentic AI Workflows on AWS Bedrock: 수강완료 (2025/4/13~04/16)

두번째 강의) Learn Agentic AI Basics, Amazon Bedrock Multi-Agent Framework (2025/4/29~06/11)

2. N8N

I. 강의 선택의 이유 / 수강 전 기대하는 부분

이번에 수강할 강의는 최근 인스타그램 등에서 광고로 많이 접한 천영록 대표님의 강의다. 제목은 'NO코딩 AI 자동화: 잘 때도 나 대신 일하는 기하급수적 성장 모멘텀'이다.

처음에는 N8N 역시 Udemy로 들으려 했다. 내가 Udemy를 좋아하는 이유 중 하나는 강의를 듣는 사용자가 학습에만 더 집중할 수 있도록 도와준다는 것과 해당 분야에 대해 깊이있고 전문적으로 내용을 다룬다는 느낌을 받기 때문이다. 또한 한국 강의시장에서의 제한된 공급으로 마련된 강의 Pool에 비해, 글로벌하게 쏟아지는 무수히 많은 강의들 중에서 살아남고 좋은 리뷰를 가지고 있는 강의인 만큼 이미 검증된 강의라는 안도감도 작용한다.

그에 반해 한국 강의 플랫폼에서 제공하는 강의들은, 매우 트랜디하고 강의 소개나 영상들이 강력한 소구를 갖는데 반해서, 막상 강의를 들어보면 개념을 개괄하는데 그치는 경우가 많았다. 어쩌면 강의 자체의 퀄리티는 해외 강의들과 다르지 않을지도 모르지만, 강의소개에서 워낙 마케팅들을 잘해놔서 강의 자체에 대한 기대감이 많이 높아진 채로 강의를 들었다는 차이점이 있을지도 모르겠다.

아무튼 각설하고, 그럼에도 불구하고 이번 천영록 대표님의 강의를 선택한 이유는 다음과 같다.

AWS Bedrock 강의를 통해서 아카데믹하고, 그저 어떻게 동작하는지를 이해하는 수준의 Multi Agent 학습이 되면 안되겠다는 생각이 들었다. Udemy에서 구매한 N8N 강의는 N8N 자체를 가르치는 강의다. 그러나 천영록 대표님의 이번 강의는 N8N 등의 툴을 활용하여 '자동화'를 이루고 가치를 만드는 결과물 중심의 강의다. 그리고 실제로 강의들을 쭉 훑어 보았을 때에도, 이론적인 부분보다는 실제 수강생이 hands-on으로 원하는 결과물을 만들어 낼 수 있도록 가이드하는 듯하다.

따라서 이번 강의는 개념을 많이 알아보고 깨우치는 강의가 되기 보다는, "어? 그럼 이런것도 만들 수 있겠네? 어, 이거 만들어보고 싶다"라는 생각이 계속 드는 강의가 되기를 희망한다. 강의 완강까지 시간이 다소 걸려도 된다. 강의를 듣다가 배운 내용을 십분 활용하여 수강 중간에라도 toy project를 시도해보면 좋겠다.

이제 본격적으로 강의로 들어간다!

II. 수업내용

1일차(25/6/11): Rapid API, n8n(rapid api, chat gpt api, firecrawl api),

1) 2강. "난생 첫 API 호출!" - API로 진짜 AI를 경험하다

가장 먼저 Rapid API라는 서비스를 통해서 직접 API Call을 해본다. Rapid API 서비스 내에서도 테스트를 하고, cURL을 통해 맥 Terminal에서도 테스트를 했다.

API 세팅을 일일이 API Key 등을 입력하지 않고 cURL만으로 한번에 세팅할 수 있다는 사실을 처음 알았다.

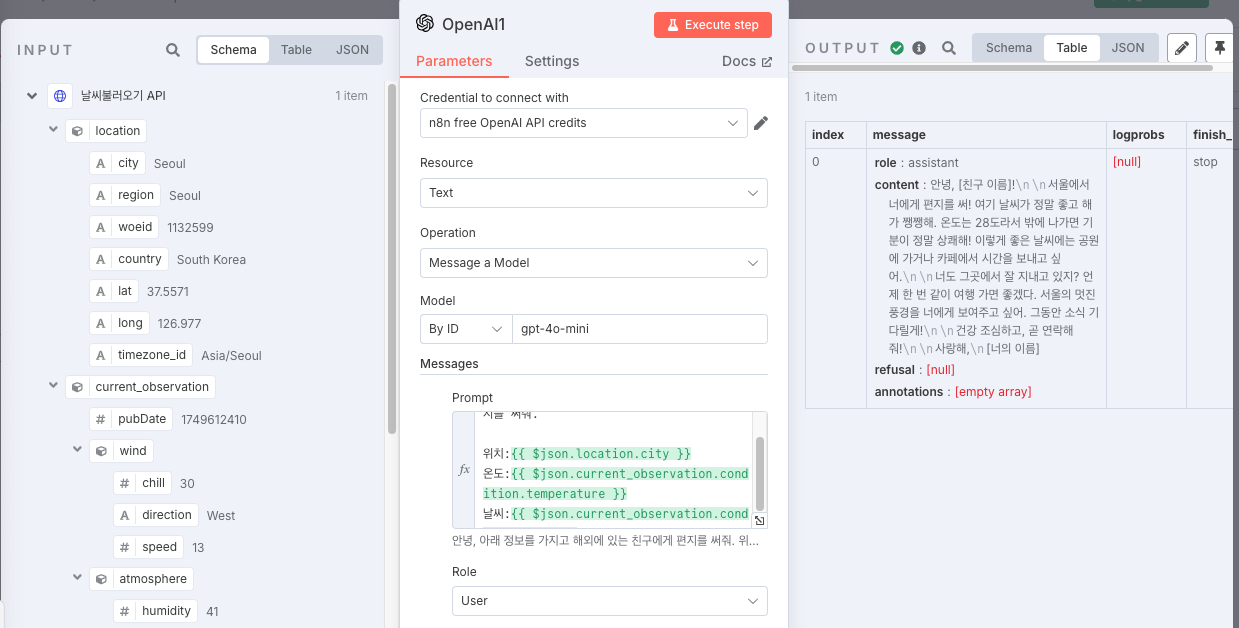

이제는 n8n에서 불러온 첫번째 날씨 API와 두번째 GPT API를 노드로 연결하여, 날씨 API의 값이 그 다음 GPT API의 Input 일부가 되도록 하는 방법을 배웠다. 이로써 두 개의 API가 나의 목적에 맞춰 data를 흘려 보내는 방식을 알게 된 것이다.

이번 강의는 지난 2강에서 만들었던 과정에서 세부적인 사항들에 대한 기술적인 설명을 한다. JSON의 구조에 대한 설명, 2강에서 했던 API Call의 비용 체계가 어떠한지 등의 내용이다.

강의에서 다룬 Chat GPT Pricing 페이지를 보면서 내 생각보다 훨씬 더 다양한 모델들이 존재한다는 것을 알게 되었다. 예를 들어 audio-preview, realtime-preview, search-preview 등의 모델은 처음 들었다.

*추가적으로 검색해보니 audio-preview는 whisper의 경량모델로서 사용자가 프롬프트 인풋으로 오디오 파일을 추가했을 때, 이를 Text로 변환해주는 모델이며, 대중적인 gpt-4.0과 같은 모델 역시도 whisper를 통해 음성인식이 가능하다고 한다.

*realtime-preview는 음성을 인식하여 빠른 응답을 제공하려고 할 때 적합하다고 한다. 다시 말해 인풋, 아웃풋의 토큰량이 많거나 추론이 필요한 프롬프트, 데이터셋에는 적합하지 않다.

Pricing

Latest models

New: Save on synchronous requests with flex processing.

Text tokens

Price per 1M tokens

Batch API price

| Model | Input | Cached input | Output |

|---|---|---|---|

gpt-4.1 gpt-4.1-2025-04-14 | $2.00 | $0.50 | $8.00 |

gpt-4.1-2025-04-14 | $2.00 | $0.50 | $8.00 |

gpt-4.1-mini gpt-4.1-mini-2025-04-14 | $0.40 | $0.10 | $1.60 |

gpt-4.1-mini-2025-04-14 | $0.40 | $0.10 | $1.60 |

gpt-4.1-nano gpt-4.1-nano-2025-04-14 | $0.10 | $0.025 | $0.40 |

gpt-4.1-nano-2025-04-14 | $0.10 | $0.025 | $0.40 |

gpt-4.5-preview gpt-4.5-preview-2025-02-27 | $75.00 | $37.50 | $150.00 |

gpt-4.5-preview-2025-02-27 | $75.00 | $37.50 | $150.00 |

gpt-4o gpt-4o-2024-08-06 | $2.50 | $1.25 | $10.00 |

gpt-4o-2024-11-20 | $2.50 | $1.25 | $10.00 |

gpt-4o-2024-08-06 | $2.50 | $1.25 | $10.00 |

gpt-4o-2024-05-13 | $5.00 | - | $15.00 |

gpt-4o-audio-preview gpt-4o-audio-preview-2024-12-17 | $2.50 | - | $10.00 |

gpt-4o-audio-preview-2025-06-03 | $2.50 | - | $10.00 |

gpt-4o-audio-preview-2024-12-17 | $2.50 | - | $10.00 |

gpt-4o-audio-preview-2024-10-01 | $2.50 | - | $10.00 |

gpt-4o-realtime-preview gpt-4o-realtime-preview-2024-12-17 | $5.00 | $2.50 | $20.00 |

gpt-4o-realtime-preview-2025-06-03 | $5.00 | $2.50 | $20.00 |

gpt-4o-realtime-preview-2024-12-17 | $5.00 | $2.50 | $20.00 |

gpt-4o-realtime-preview-2024-10-01 | $5.00 | $2.50 | $20.00 |

gpt-4o-mini gpt-4o-mini-2024-07-18 | $0.15 | $0.075 | $0.60 |

gpt-4o-mini-2024-07-18 | $0.15 | $0.075 | $0.60 |

gpt-4o-mini-audio-preview gpt-4o-mini-audio-preview-2024-12-17 | $0.15 | - | $0.60 |

gpt-4o-mini-audio-preview-2024-12-17 | $0.15 | - | $0.60 |

gpt-4o-mini-realtime-preview gpt-4o-mini-realtime-preview-2024-12-17 | $0.60 | $0.30 | $2.40 |

gpt-4o-mini-realtime-preview-2024-12-17 | $0.60 | $0.30 | $2.40 |

o1 o1-2024-12-17 | $15.00 | $7.50 | $60.00 |

o1-2024-12-17 | $15.00 | $7.50 | $60.00 |

o1-preview-2024-09-12 | $15.00 | $7.50 | $60.00 |

o1-pro o1-pro-2025-03-19 | $150.00 | - | $600.00 |

o1-pro-2025-03-19 | $150.00 | - | $600.00 |

o3-pro o3-pro-2025-06-10 | $20.00 | - | $80.00 |

o3-pro-2025-06-10 | $20.00 | - | $80.00 |

o3 o3-2025-04-16 | $2.00 | $0.50 | $8.00 |

o3-2025-04-16 | $2.00 | $0.50 | $8.00 |

o4-mini o4-mini-2025-04-16 | $1.10 | $0.275 | $4.40 |

o4-mini-2025-04-16 | $1.10 | $0.275 | $4.40 |

o3-mini o3-mini-2025-01-31 | $1.10 | $0.55 | $4.40 |

o3-mini-2025-01-31 | $1.10 | $0.55 | $4.40 |

o1-mini o1-mini-2024-09-12 | $1.10 | $0.55 | $4.40 |

o1-mini-2024-09-12 | $1.10 | $0.55 | $4.40 |

codex-mini-latest codex-mini-latest | $1.50 | $0.375 | $6.00 |

codex-mini-latest | $1.50 | $0.375 | $6.00 |

gpt-4o-mini-search-preview gpt-4o-mini-search-preview-2025-03-11 | $0.15 | - | $0.60 |

gpt-4o-mini-search-preview-2025-03-11 | $0.15 | - | $0.60 |

gpt-4o-search-preview gpt-4o-search-preview-2025-03-11 | $2.50 | - | $10.00 |

gpt-4o-search-preview-2025-03-11 | $2.50 | - | $10.00 |

computer-use-preview computer-use-preview-2025-03-11 | $3.00 | - | $12.00 |

computer-use-preview-2025-03-11 | $3.00 | - | $12.00 |

gpt-image-1 gpt-image-1 | $5.00 | $1.25 | - |

또한 강의에서 흥미로웠던 부분은 LLM에 기억이 있나?에 관한 부분이다. 이는 Bedrock 강의에서 배운 Memory 라는 부분과도 닿아있다. 당시 활용하였던 Claude의 경우 세션 별로 Memory를 최대 365일까지 할당할 수 있었다. 그러나 별도의 세션으로 진행 시에는 이전의 맥락을 반영(기억)하지 못한다. API로 호출되는 LLM 역시 이전의 대화내용들을 기억하지 못한다고 한다. 그렇다면 API로 호출 시에 이전의 Session ID를 함께 제공하는 경우 기억을 할 수 있을까? 궁금한 마음에 대표님께 질문을 남겨놓았다.

3) 4강. "AI 에이전트, 1분 컷?" - 나만의 AI 비서 만들기

이번 강의에서는 처음으로 AI Agent를 만든다. 좀 더 부연하자면, 단순한 자동화 흐름을 넘어서 사용자와 상호작용하는 챗봇 형태의 에이전트를 만든다.

강의 내용에 따라 만든 에이전트다. Tool 부분에 Yahoo Weather API를 연결하였는데, "도쿄 날씨?"라고 아무리 물어보아도 제대로 답을 하지 않다가, Agent 란의 Description에 '날씨 문의가 오는 경우 연동된 Tool을 활용해줘'라고 기입하니 그제야 제대로 동작했다.

(4강 수업 진행 중)

댓글

댓글 쓰기